Les LLMs peuvent-ils améliorer la prise de décision collective ?

Ce que la recherche nous apprend

Résumé

Lorsqu'un groupe doit prendre une décision dans une équipe, un atelier ou une organisation, on s'attend souvent à ce que le collectif fasse mieux que chacun de ses membres. L'arrivée des modèles de langage (LLMs) dans ces contextes soulève pourtant une question simple : l'IA améliore-t-elle réellement nos décisions, ou peut-elle parfois les dégrader ?

À partir d'une expérience d'intelligence collective simple et reproductible, cette conférence montre comment l'usage naïf de l'IA peut conduire à des décisions très convaincantes en apparence, mais moins fiables en pratique.

En s'appuyant sur les travaux récents de recherche sur l'intelligence collective et la délibération assistée par IA, nous analysons dans quels cas l'IA affaiblit ou renforce une décision collective, et pourquoi ces effets dépendent avant tout de la manière dont elle est intégrée.

La conférence propose enfin une grille de lecture pour penser l'IA comme un outil de facilitation plutôt que comme une autorité, et aider les équipes à concevoir des dispositifs collectifs plus robustes et plus transparents.

Format

Présentation suivie d'une Q&R · Conférence technique (45 min)

Public cible

Équipes data, décideurs, passionnés de technologie. Aucun pré-requis technique spécifique.

Prérequis

Aucun pré-requis technique spécifique

Présenté précédemment

- Decathlon: Facilitators community, Global Data team — Février 2026

- Theodo: Internal tech talk — Février 2026

- Data Days Lille 2026 — Mars 2026

Contenu détaillé Revele le contenu de la conference

La promesse de départ

En 2016, Taïwan régule l'arrivée d'Uber via Polis, une plateforme de délibération numérique développée par la communauté civique g0v : des milliers de citoyens soumettent des propositions, votent, et la plateforme cartographie les zones de convergence entre des parties aux intérêts opposés. Le débat force Uber à se positionner publiquement. Une loi passe. C'est la première fois qu'une technologie structure une décision publique à grande échelle.

La question qui en découle : avec des LLMs capables de traiter des milliers d'opinions textuelles, peut-on aller plus loin : résumer, synthétiser, agréger pour prendre de meilleures décisions collectives, plus vite ?

Pourquoi l'approche naïve échoue : trois niveaux

En guise d'illustration d'entrée

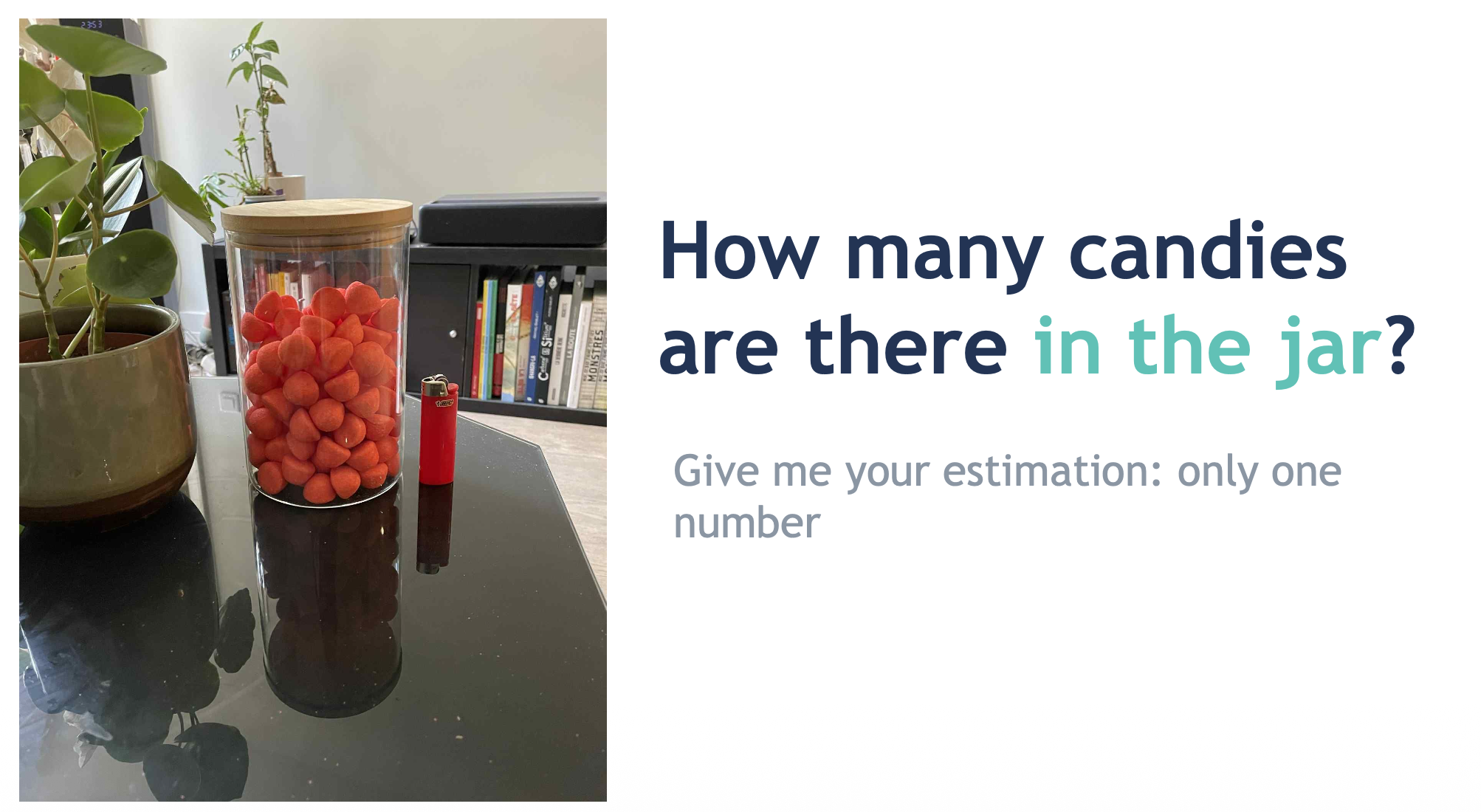

Reproduisant l'expérience de Galton (1907) avec un bocal de bonbons, la conférence montre comment un LLM consulté avant d'estimer introduit un effet d'ancrage qui homogénéise les réponses individuelles et dissout la sagesse des foules. Ce n'est qu'une première intuition. La conférence se concentre ensuite sur les decision-making tasks : décisions collectives sans solution vérifiable (stratégie d'organisation, politique publique), pour lesquelles les fonctions d'agrégation classiques ne fonctionnent tout simplement pas.

Agréger naïvement des opinions via un LLM pose quatre problèmes structurels. La fenêtre de contexte limite le volume d'avis ingérable (300 à 1 500 pages selon les modèles). Les hallucinations rendent le résumé potentiellement infidèle aux sources. La tendance à pondérer par fréquence écrase les idées brillantes mais rares. Enfin, les LLMs sont politiquement positionnables sur des axes normés de façon reproductible ; ce biais peut avantager systématiquement certaines positions dans une synthèse.

Des contre-mesures existent :

- Fenêtre de contexte → résumés hiérarchiques par topic

- Hallucinations → génération ancrée sur citations (RAG), vérifiable par un humain

- Opinions minoritaires → LLM-as-a-Judge : un modèle tiers vérifie que chaque opinion individuelle est reflétée dans le résumé final

- Biais → ouverture totale des modèles (poids, données, procédures). Ex : Aperture (EPFL / ETH Zürich)

Niveau plus fondamental : même une agrégation parfaite ne suffit pas. L'exemple de 12 Hommes en Colère (Lumet, 1957) est central : agréger les opinions initiales des jurés (11 voix pour la culpabilité) aurait donné le mauvais verdict. C'est la délibération, l'échange d'informations et la confrontation des vécus, qui renverse collectivement le jugement. La délibération n'est pas un luxe : c'est une condition de qualité.

Mais la délibération elle-même est sujette à des biais bien documentés. Lorsqu'on laisse un groupe délibérer librement, quatre mécanismes dégradent la qualité de la décision : l'effet des profils cachés, ou les participants tendent à ne discuter que des informations déjà partagées et à ne pas révéler des informations privées potentiellement clés ; le piège de l'homogénéité cognitive, ou la similarité des participants réduit la diversité des angles d'analyse ; l'inégalité des temps de parole, ou les personnes les plus loquaces écrasent les opinions des autres ; et enfin la polarisation naturelle, ou les débats extrémisent les positions plutôt que de les rapprocher. C'est précisément pour mitiger ces effets qu'un protocole structuré est nécessaire, et que l'IA peut y jouer un rôle utile, à condition d'être intégrée à chaque étape comme outil, pas comme décideur.

- Galton, F. Vox Populi. Nature, vol. 75, 1907. doi: 10.1038/075450a0

- Santurkar, S. et al. Whose Opinions Do Language Models Reflect? ArXiv, 2023.

- Feng, S. et al. From Pretraining Data to Language Models to Downstream Tasks. arXiv, 2023. doi: 10.48550/ARXIV.2305.08283

- Small, C.T. et al. Opportunities and Risks of LLMs for Scalable Deliberation with Polis. arXiv, 2023. doi: 10.48550/ARXIV.2306.11932

- Lu, L. et al. Twenty-five years of hidden profiles in group decision making. Pers Soc Psychol Rev, 2012. doi: 10.1177/1088868311417243

- Kerr, N.L. & Tindale, R.S. Group performance and decision making. Annu Rev Psychol, 2004. doi: 10.1146/annurev.psych.55.090902.142009

Ce que la recherche récente propose

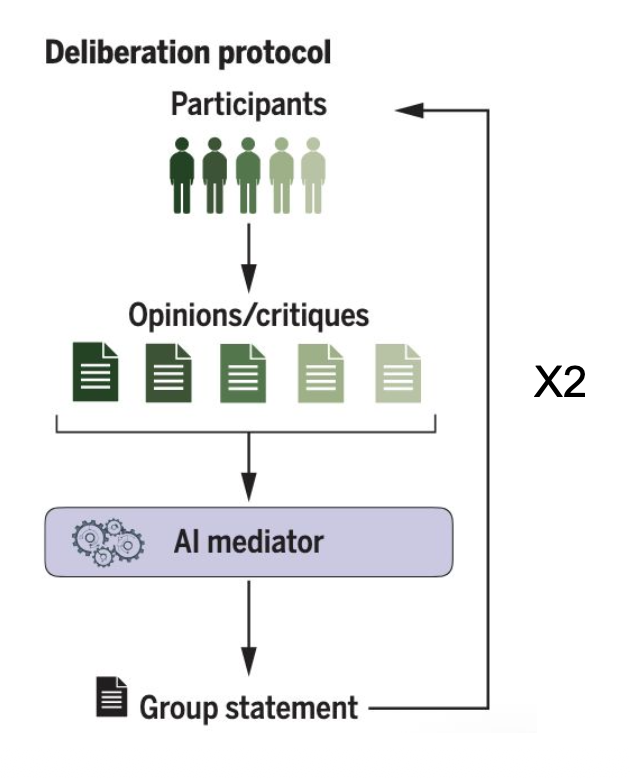

Tessler et al. (2024, Google DeepMind, publié dans Science) : un LLM entraîné spécifiquement agrège les opinions individuelles et génère un group statement, une position commune candidate. Ce statement est soumis aux participants qui le critiquent. Le LLM intègre ces critiques et produit un final group statement. Les groupes convergent plus vite qu'en délibération classique avec modérateur, et les participants préfèrent en moyenne ce mode assisté. La question de la désirabilité est posée explicitement par les auteurs eux-mêmes.

Plurals (Ashkinaze et al., 2025) : des agents LLMs personnifient des profils sociaux échantillonnés dans une population cible. Ces agents délibèrent entre eux, modérés par un agent-modérateur, et produisent des argumentaires. Sur l'exemple des panneaux photovoltaïques dans les jardins privés, les argumentaires générés sont jugés acceptables par les communautés concernées. Même réserve : substituer des agents aux délibérants humains pose la question de la légitimité du processus.

Ces deux expériences soulèvent la même question sous-jacente : pourquoi décide-t-on collectivement ? Ce n'est pas seulement une question d'efficacité ; c'est d'abord une question de valeurs. Lazar & Manuali (2024) proposent un cadre de six valeurs :

Instrumentales · efficacité

Intelligence collective Transformation des opinions Conciliation

Non-instrumentales · légitimité

Égalité des voix Participation intrinsèque Légitimité perçue

Un usage de l'IA qui optimise l'efficacité au détriment de la participation ou de la légitimité perçue n'est pas nécessairement souhaitable, même s'il produit des résultats techniquement supérieurs.

- Tessler, M.H. et al. AI Can Help Humans Find Common Ground in Democratic Deliberation. Science 386, n° 6719, 2024. doi: 10.1126/science.adq2852

- Ashkinaze, J. et al. Plurals: A System for Guiding LLMs via Simulated Social Ensembles. CHI, 2025. doi: 10.1145/3706598.3713675

- Lazar, S. & Manuali, L. Can LLMs advance democratic values? arXiv, 2024. doi: 10.48550/ARXIV.2410.08418

La proposition concrète

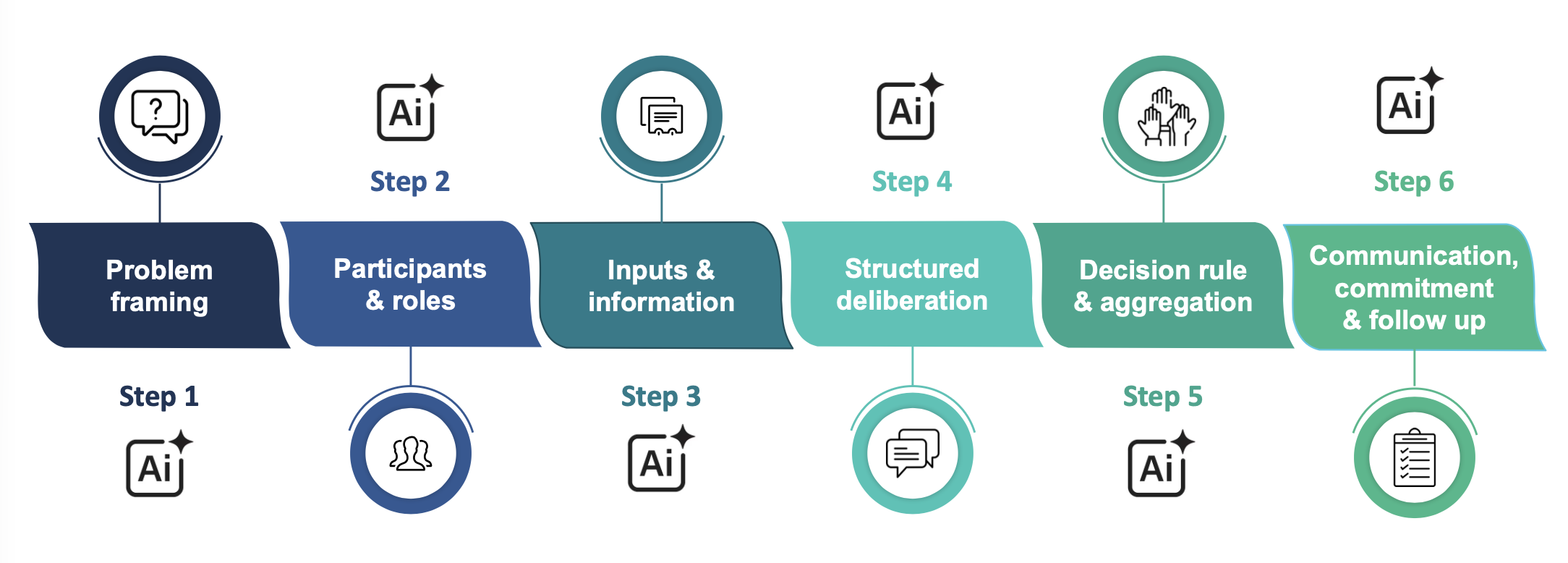

Plutôt que de substituer l'IA au processus délibératif, la conférence propose de l'insérer à chaque étape d'un protocole structuré en 6 étapes : débiaisage du cadrage du problème (1), aide à la sélection représentative des participants (2), sparring partner individuel avant le débat collectif, ou chaque participant teste et affine ses arguments avant d'entrer en discussion (3), facilitation des temps de parole et détection de polarisation (4), agrégation (5), communication et suivi (6).

L'IA comme outil de facilitation à chaque nœud du processus, pas comme raccourci vers une synthèse finale. La qualité de l'intégration importe plus que la sophistication du modèle.